Ein Blick in die aktuelle Marketinglandschaft zeigt ein paradoxes Bild: Laut der Studie „State of Marketing 2026“ von McKinsey geben 94 Prozent der europäischen Marketingverantwortlichen an, noch keine signifikanten Wettbewerbsvorteile durch KI erzielt zu haben, obwohl drei von vier CMOs ihre KI-Budgets für das laufende Jahr erhöhen.

Längst wird in so manchem Fotostudio kein Licht mehr gesetzt; stattdessen generiert ein Prompt-Engineer das perfekte Kampagnenmotiv für eine Herbstkollektion. Doch während das Bild auf dem Monitor Form annimmt, stellt sich die entscheidende Frage: Wird der Kunde das Produkt noch kaufen, wenn ab August ein obligatorischer Hinweis am Bildrand erscheint, der die echt wirkende Szenerie als künstliches Konstrukt entlarvt?

Alles im grünen Bereich – KI im Hintergrund

Häufig wird KI im Marketing im „Maschinenraum“ eingesetzt, also dort, wo sie für Endverbraucher nicht sichtbar ist. Unter dem Begriff „Invisible AI“ werden Anwendungen zusammengefasst, die primär die Effizienz und Treffsicherheit von Marketingmaßnahmen steigern, ohne den Content selbst synthetisch zu erzeugen. Sie personalisieren beispielsweise Webseiten-Layouts in Echtzeit basierend auf den Absichten der Nutzer oder erkennen Kundenbedürfnisse noch bevor diese explizit geäußert werden.

Ein klassisches Beispiel ist die Hyperpersonalisierung im E-Commerce: Hier sehen Kunden keine generischen Rabatt-Banner mehr, sondern ein komplett individuell kuratiertes Sortiment, bei dem die KI im Verborgenen entscheidet, welche Produkte und Preise für genau diesen Moment relevant sind.

Solche unsichtbaren Anwendungen sind vom AI Act nicht betroffen und müssen nicht gekennzeichnet werden. Anders liegt der Fall hingegen bei Inhalten, die von KI sichtbar generiert werden. Dazu zählen insbesondere Texte, Bilder und Videos. Die neuen Kennzeichnungspflichten des AI Act zielen jedoch nicht darauf ab, die Content-Produktion mit KI im Marketing zu verbieten. Ziel ist vielmehr, Täuschungen zu verhindern.

Die einfache Variante – KI-generierte Texte

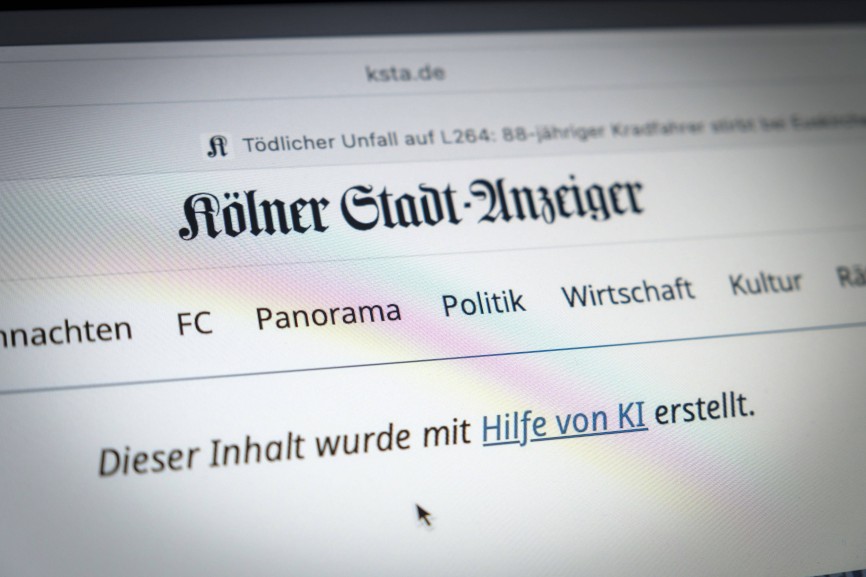

Texte müssen künftig als KI-generiert gekennzeichnet werden, wenn sie von öffentlichem Interesse sind. Diese Pflicht entfällt jedoch, wenn ein Mensch den Text überprüft hat („Human-in-the-Loop“) und eine Person oder das Unternehmen die redaktionelle Verantwortung für die Veröffentlichung übernimmt. „Ohne diese menschliche Kontrolle ist ein deutlicher Hinweis auf den KI-Ursprung zwingend erforderlich“, betont Joerg Heidrich, Fachanwalt für IT-Recht bei der Heidrich Rechtsanwälte Partnerschaftsgesellschaft. Der Jurist rät dazu, einen festen Redaktionsprozess zu etablieren, bei dem Mitarbeiter KI-Entwürfe prüfen und freigeben, um die redaktionelle Verantwortung zu dokumentieren und Warnhinweise zu vermeiden.

Allerdings ist die Wahrscheinlichkeit, dass Werbetexte für Produkte eine „Angelegenheit von öffentlichem Interesse“ sind, sehr gering. Hier zielt der Gesetzgeber eher auf eine unkontrollierte politische Einflussnahme durch die maschinelle Verbreitung bestimmter politischer Meinungen und Kommentare.

Vorsicht Deepfakes – besondere Anforderungen für Bilder und Videos

Wer hingegen Bilder und Videos für seine Werbekampagnen von KI generieren lässt, fällt schnell unter die Kennzeichnungspflicht. Geregelt wird die Kennzeichnungspflicht in Artikel 50 des EU AI Acts, der hierzulande auch als „KI-Verordnung“ bezeichnet wird. Die Anbieter von KI-Systemen müssen demnach die KI-erzeugten Inhalte künftig in maschinenlesbarer Form kennzeichnen, zum Beispiel im Meta-Text, wie es Midjourney schon heute praktiziert. Andere Plattformen wie Facebook oder Instagram können diese unsichtbaren Metadaten auslesen und Bilder automatisch mit einem Hinweis wie „Mit KI generiert“ versehen. Darüber hinaus müssen auch die Betreiber von KI-Systemen, beispielsweise Werbetreibende, die mithilfe von KI Bilder und Videos generieren, unter bestimmten Umständen die Inhalte als KI-generiert kennzeichnen.

„Die wichtigsten Kennzeichnungspflichten für die meisten Unternehmen beschränken sich auf die Kennzeichnung von Deepfakes sowie die Kennzeichnung von Informationen, die die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse informieren, zum Beispiel politische Kommentare. Außerdem müssen Nutzer informiert werden, wenn sie mit einer KI kommunizieren, beispielsweise mit einem KI-Kunden-Chatbot“, erläutert Lev Lexow. Der Rechtsanwalt ist Geschäftsführender Gesellschafter der Rechtsanwaltsgesellschaft Siebert Lexow. Deepfakes müssen in jedem Fall als KI-generiert gekennzeichnet werden. Artikel 3 der KI-Verordnung definiert Deepfake als „KI-generierte oder manipulierte Bild-, Audio- oder Videoinhalte, die existierenden Personen, Objekten, Orten, Einrichtungen oder Ereignissen ähneln und einer Person fälschlicherweise als authentisch oder wahrheitsgemäß erscheinen würden“.

Für die Kennzeichnung gibt es noch keinen Standard. Bis ein EU-weites, einheitliches Symbol zur Kennzeichnung festgelegt ist, kann laut eines ersten Entwurfs der EU-Kommission ein vorläufiges Icon verwendet werden, um eine einheitliche Offenlegung zu gewährleisten. Dieses Symbol soll ein zweibuchstabiges Akronym für künstliche Intelligenz sein, sollte also aus den Buchstaben AI oder KI bestehen.

Jetzt das Gespräch mit Agenturen suchen

Die Kennzeichnungspflicht greift ab August dieses Jahres. Es bleibt also noch genug Zeit, sich zunächst im eigenen Unternehmen einen Überblick zu verschaffen, welche Inhalte mit KI erstellt werden. Doch in der Regel entstehen Kampagnen in Zusammenarbeit mit Dienstleistern. Vorsicht: Wer mit externen Agenturen zusammenarbeitet, trägt in der Regel auch Verantwortung für deren Output. In vielen bestehenden Verträgen fehlen aber klare Regelungen zum Einsatz von KI. Wenn eine Agentur etwa KI-Tools nutzt, um Social-Media-Texte, Visuals oder ganze Kampagnenideen zu entwickeln, muss transparent sein, wie diese Inhalte entstehen – und ob sie entsprechend gekennzeichnet werden müssen.

Wer mit Agenturen zusammenarbeitet, sollte das Thema KI direkt vorab klären, rät Lexow. Bei welchen Inhalten darf KI in welchem Umfang eingesetzt werden? Gibt es Bereiche, in denen der Einsatz von KI generell verboten sein soll? Muss die Agentur darüber informieren, ob und wo sie KI einsetzt? „Gerade für größere Unternehmen ist es hierbei sinnvoll, sich interne Leitlinien für diese Fälle zu erstellen. Das erleichtert die Verhandlungen mit Vertragspartnern in der Regel“, sagt Lexow.

KI-Einsatz vertraglich regeln

Im Idealfall sollte die Verwendung von KI durch die Agentur lückenlos dokumentiert werden. Ebenso sollte sich der Dienstleister dazu verpflichten, technische Standards einzuhalten. Das Problem: Der AI Act verlangt von den Anbietern – also den LLMs – maschinenlesbare Kennzeichnungen (zum Beispiel Metadaten) für KI-Bilder. Diese müssen allerdings auch bei einer Weiterverbreitung des Contents erhalten bleiben. Die Agentur muss garantieren, dass die gelieferten Daten diese Informationen enthalten. Wenn beispielsweise eine Agentur ein Deepfake mit Midjourney erstellt, wird Midjourney das Bild im Metatext als KI-generiert kennzeichnen und damit seine Pflicht erfüllen. Diese Kennzeichnung muss erhalten bleiben – und sie entbindet die Agentur als Nutzer des Bildes nicht, es in der Werbekampagne zusätzlich sichtbar als KI-generiert zu kennzeichnen.

Die Zeit bis zum August sollten Marken daher nutzen, um solche Details mit ihren Agenturen zu besprechen. „Da Marken als Auftraggeber meist als ‚Betreiber‘ der KI gelten und entsprechende Pflichten haben, haften sie im Regelfall für die Einhaltung der Regeln“, sagt Fachanwalt Heidrich. Er rät werbenden Unternehmen dazu, vertraglich festzulegen, dass ihre Agenturen den Einsatz von KI offenlegen müssen und garantieren, dass alle Inhalte technisch korrekt markiert sind. „Klären Sie zudem schriftlich, wer die redaktionelle Endabnahme durchführt, um rechtlich auf der sicheren Seite zu sein“, so der Experte.

Transparenz als Chance nutzen

Dass durch die Kennzeichnungspflicht weniger KI in der Content-Kreation eingesetzt wird, gilt unter Marktbeobachtern als unwahrscheinlich. Ein Grund ist der massive Kostenvorteil. Die Kennzeichnung von KI-Inhalten dürfte daher schnell zum gewohnten Anblick werden. Lediglich für Marken, die Authentizität ins Zentrum ihrer Kommunikation stellen, könnte die Verwendung von KI-generierten Bildern und Videos problematisch werden, wenn diese als solche erkennbar sind. Für die große Mehrheit der Marken dürfte sich die neue Transparenz hingegen positiv auswirken. Entscheidend ist dabei der Kontext: In Kampagnen, die bewusst auf visuelle Fiktion setzen – etwa bei futuristischen Produktinszenierungen oder spielerischen Imagewelten – stört die Kennzeichnung kaum. Im Gegenteil, hier kann sie sogar zur Markenbotschaft passen.

„KI lohnt sich in der Content Creation weiterhin – auch bei fotorealistischen oder pseudo-fotorealistischen Inhalten“, ist André Schier, Trainer und KI-Fachexperte am Deutschen Institut für Marketing, überzeugt. Da der EU AI Act fotorealistische KI-Inhalte nicht verbietet, sondern lediglich eine korrekte Kennzeichnung verlangt, werden nach seiner Einschätzung die Vorteile überwiegen: „Gerade im Marketing kann KI bei begrenzten Budgets und Ressourcen sinnvoll sein, etwa um fotorealistische Motive zu erzeugen, Varianten zu testen oder Produktszenarien effizient zu visualisieren. Transparenz und Kennzeichnungspflicht sind dabei kein kreatives Hindernis, sondern ein Ordnungsrahmen“, betont der Experte.

Gleichzeitig könne KI das entscheidende Werkzeug für Kreativität und Originalität sein und dabei helfen, Sichtbarkeit und Reichweite zu erzeugen. Aus Schiers Sicht bleibt KI ein leistungsfähiges Werkzeug im Marketing, „wenn sie sauber gekennzeichnet und verantwortungsvoll eingesetzt wird“.